建築分野で話題の画像生成AI – Stable DiffusionとMidjourneyを実際に使って比較してみた。

はじめに

近年、ChatGPTが話題になり、業務での活用を検討し始めた方も多いのではないでしょうか。AIがますます身近な存在になる中で、今回は画像生成AIについて利用/比較検討をしてみました。画像生成AIは国内では広告用のイメージ画像作成やゲームイラストなどにいち早く利用されていますが、建設分野では?無機物の出力はできるの?どのAIを使えばいいの?と、わからないことも多いと思います。そんな皆様の一助となれば幸いです。

この記事ではこのような内容が学べます:

・画像生成AI(ジェネレーティブAI)とは

・Midjourneyとは

・Stable Diffusionとは

・それぞれの機能の比較

画像生成AI(ジェネレーティブAI)とは

画像生成AIとは、ディープラーニングを利用して自動的に画像を生成する画像生成モデルを指し、インターネット上の膨大な画像を学習したAIが、ユーザの指示に従って新しい画像を生成することができるものです。これらのAIでは、画像を元に画像を生成する、image to imageと呼ばれる機能や、プロンプトと呼ばれる命令文(テキスト)を元に画像を生成するtext to imageと呼ばれる機能が利用可能です。近年ではよりユーザが使いやすいようにサービス化したMidjourneyやDALL-E 2などが話題になったり、オープンソースで完全無償で利用できるStable Diffusionの提供が開始されたりと、さらなる盛り上がりを見せています。

Midjourney とは

Midjourney とは

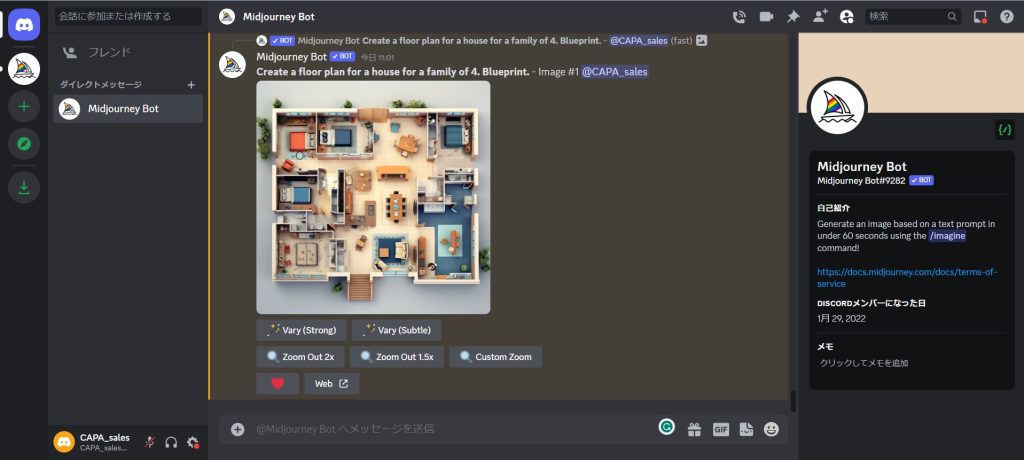

Midjourneyとは、アメリカの民間研究所であるMidjourneyによって提供されるテキストからイラストを生成するAIサービスです。DiscodeというLINEのようなチャットサービスを通じて利用可能であり、チャットで生成したい画像を書き込むだけで誰もが簡単に画像を生成することができます。MidjourneyはオリジナルのAIモデルを利用しており、2023年6月現在では最新版のMidjourney5を利用可能です。*1

Midjourneyのスクリーンショット画像

Midjourneyの機能

Midjourneyでは/imagineコマンドと、作成したい画像の詳細を記入するプロンプト、画像のアスペクト比などを指定するパラメータによって画像を生成します。

Imagineコマンドの例: /imagine [プロンプト][パラメータ]

ここで重要なことは、ユーザができることはあくまでもテキストと参考画像による指定のみであり、出力される画像はランダムであることです。基本的には、ユーザはプロンプトを工夫しながら、自分のイメージにあう画像が出力されるまで出力を繰り返す形となります。

Midjourneyの建築分野での活用

構図やライティングも含めて厳密な画像を作成する、というよりは、大量のイメージ画像を作成したり、アイデアの元にしたり、自身の顧客とのイメージのすり合わせに利用する。といったほうが得意でしょう。

Midjourneyの生成画像例/エクステリア

Exterior of small library designed by Tadao Ando, eye-level, photorearistic.

Midjourneyの生成画像例/インテリア

Interior of small library designed by Renzo Piano, eye-level, photorearistic.

Stable Diffusionとは

Stable Diffusionとは

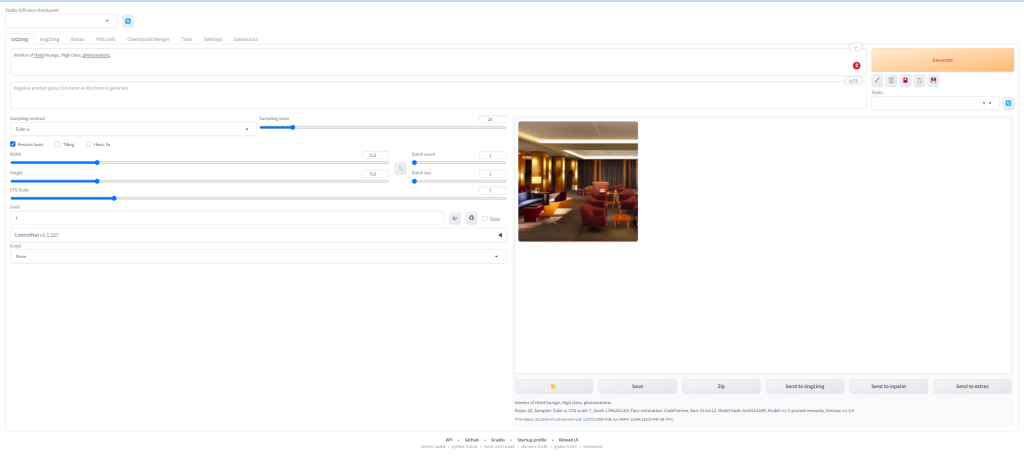

Stable Diffusionとは、英国のStability AI社が開発した画像生成モデルであり、テキストからの画像生成、元画像からの画像生成が可能です。オープンソースであり、だれでも無料で利用可能であることから爆発的に広まりました。周辺プログラムも盛んに開発されており、中でも利用者の多いプログラムとして、Web-UIを付与するStable Diffusion Web UIと、イラストをより細かく制御できるControlNetが挙げられます。環境構築にプログラミングの知識が必要となるため少し敷居の高い部分もありますが、Midjourneyとはまた違った魅力のあるモデルです。*2

Stable diffusion Web GUIのスクリーンショット

Stable Diffusionの機能

Stable Diffusionは単体ではMidjourneyと同様、テキストからの画像作成/画像からの画像作成ができるのみですが、Control Netを利用することでその活用の幅は大きく広がります。Control Netは画像内の特定の要素の条件付けを行うものであり、構図の設定や、背景など特定部分のみの変更、線画のみをそのまま利用するなど、より画像生成をするユーザの好みに合わせた形にチューニングすることができます。これらは現状、他の画像生成AIが苦手としていた分野であり、ControlNetを利用できることがそのまま、Stable Diffusionの強みになると言っても過言ではないでしょう。*3

Stable Diffusionの建築分野での活用

Control Netを活用することで、

1. 画像の構図の指定

2. シンプルな手書き/BIMモデルからのイメージ画像の出力

3. 外壁のテクスチャ変更による、パターニングされたイメージの作成

などが可能となります。現状、Midjourneyと比較すると生成できる画像が粗いなどの課題はあるものの、より従来の実務に取り入れやすいAIであることは間違いないでしょう。

機能の比較

機能の比較は下記の通りです。Midjourneyの利点はSaaSであるため、ITやプログラミングの知識なしに誰でもが利用できること、フォトリアリスティックな表現が得意であり、高品質な写真、イメージを容易に出力できることと言えるでしょう。一方で、Stable Diffusionはオープンソースのプログラムであるため導入のハードルは高いものの、Control Netを利用することで、構図や輪郭を指定できることから詳細な指定をしたい建築パースなどの分野においては大きな力を発揮しそうです。

また、Midjourneyは継続して利用料が発生しますがStable Diffusionはオープンソースのプログラムであるため、適切なGPUのマシンを購入し一度構築をしてしまえば、その後利用料がかからない点もメリットです。

| Midjourney | Stable Diffusion + Control Net | |

| 可能なこと | ・テキスト(プロンプト)からの画像生成・画像からのプロンプト生成・画像を元にした画像生成 ・イメージを優先 ・高解像度画像の生成 | ・テキスト(プロンプト)からの画像生成・画像を元にした画像生成 ・イメージを優先 ・構図を優先 ・輪郭を優先 |

| 導入の容易さ | SaaSのため、容易 | オープンリポジトリとしての提供。Gitからの構築が必要であり、ITの知識が必要 |

| コストパフォーマンス | 1枚あたり、4.32円 (※StandardPlanの場合) | GPUのあるPCを保有している場合、利用料は無料。 |

まとめ

それぞれに得意分野の異なるMidjourneyとStable Diffusionですが、例えばRevitやArchiCADなどのBIMソフトウェアで作成した構図や、手書きのドローイングをStable Diffusionにインポートし、出力。Stable Diffusionからの出力をさらにMidjourneyのインポートデータとして利用することで高解像度化を行うなど連携して利用することで、2つのAIのいいところ取りをすることも考えられます。様々な分野で活用が進むAIですが、建築分野でも私たちの強い味方となってくれそうですね。

参考:

*1 https://www.midjourney.com/

*2 https://ja.stability.ai/stable-diffusion

*3 https://ascii.jp/elem/000/004/137/4137393/