個人情報保護委員会によるOpen AIに対する注意喚起を読み解く

Open AI社が提供する文章生成AI「Chat GPT」は、その応答文のクオリティの高さで衝撃を与えました。あまりに便利なことから、ビジネスはもちろん学習分野でも多くの活用が期待されています。

その一方、さまざまな問題点についても指摘されていることから、ルール化なども話題になっています。

今回は、国の機関である個人情報保護委員会から、ChatGPT利用に関して出された注意喚起の内容を読み解いていきましょう。

この記事でわかること

・Open AIに対して出された注意喚起の内容

・個人情報取扱事業者・行政機関・個人を対象に出された注意喚起の内容

・Chat GPTを利用する上で注意すべきこと

Open AIに対して出された注意喚起の内容

個人情報保護委員会は、内閣府の外局に設置された政府の機関です。個人情報保護法に基づき、対象となる事業者への監督権限を集約することを目的として発足しました。

立入検査の権限も持っていることから、実行力がある機関です。*注1

個人情報保護委員会は、令和5年6月1日付けでOpen AI社に対して、法令に基づく注意喚起を行いました。その内容はわずかA4用紙1枚の文章であり、大きな項目は次の2点のみです。

1)本人の同意なしに「要配慮個人情報」を取得しないこと

2)(個人情報の)利用目的を日本語で明記し、通知すること

「要配慮個人情報」とは、個人情報の中でも特に取り扱いに配慮が必要なものとして、「個人情報の保護に関する法律」第2条(第3項)に、具体的な例が記載されています。

「本人の人種、信条、社会的身分、病歴、犯罪の経歴、犯罪により害を被った事実その他」が該当します。政令や規則などで、さらに詳細な例が示されていますが、ここではあまり深入りしないこととします。

ここまでは既に法令に明記されていることですから、本来であればわざわざ文章にして注意喚起など大袈裟にしなくても良さそうです。Chat GPTが世間で注目され、急速にユーザーが増えているという状況を背景に、「ここで一回釘を刺しておこう」ぐらいのものではないかと思われます。

Chat GPTは、報道によると地方自治体などでの利用も拡大しそうです。もし、どこかの行政職員がついうっかり、住民情報を入力してしまうようなヒューマンエラーが発生した時に「Open AI側でちゃんと防止措置をとってないとダメでしょう」と言われないための予防策ではないか?と思うのは少々穿った見方でしょうか。

1)に関しては、さらに「特に遵守すること」として4項目が明記されています。

Open AIが個人情報を習得する場面は大きく2つに分けられます。1つはユーザーがプロンプトに入力した情報。もう一つは機械学習・モデル構築を目的として、Open AIが独自に収集する情報です。これにはユーザーが入力した情報も一部含まれているはずです。

具体的な4項目は「機械学習を目的として情報を収集する際」と、具体的に限定しています。その上で単に「収集しないこと」ではなく、「収集しないような取り組みをすること」と、より踏み込んだ注意がなされています。

書いてあることをごく簡単にわかりやすく翻訳すると、

1-1)「要配慮個人情報」を収集しない仕組みを作りなさい(入り口)

1-2)収集された情報に「要配慮個人情報」が紛れ込んでいたら、削除する仕組みを作りなさい(内部)

1-3)それでも「要配慮個人情報」があることに気づいたら、削除するか個人と紐づかない仕組みを作りなさい。リミットは学習モデルに反映させるまでです。

という、念の入れようです。

なんだか、Open AIのことを全く信用していないのではないか?と思えるような書き方です。

個人情報保護委員会には立入検査の権限がありますので、Open AIとしても「目にみえる対策」を作った上で、何らかの形で発表した方が良いと考えたのでしょう。

4項目目には、「本人又は個人情報保護委員会等が要配慮個人情報を収集しないよう要請・指示したときは従いなさい。」と記述されています。

そもそも、本人の同意なしに収集したらダメだと最初に書いてあるのに、重ねて記載する念の入れようです。

全体を通して感じることは、「そもそも法令で定められていることなのに、なんでわざわざ?」と言うことです。Open AIへの注意喚起ももちろん大切なのでしょうが、現段階で文章を出すことで社会に対して「個人情報保護委員会がちゃんと見てるよ」と、アピールする目的もあるのかもしれません。*注2

個人情報取扱事業者・行政機関・個人を対象に出された注意喚起の内容

Open AIへの注意喚起に合わせて、もう一本別の文章が出されています。Chat GPTに限らず、文章や画像などの生成AIの利用に関するものです。

文章が出された相手は「個人情報取扱事業者・行政機関・個人」であり、ほぼ全ての企業・団体・組織・人が対象となっています。

個人情報取扱事業者とは、個人情報をデータベースとして管理し事業目的で利用している事業者です。以前は5,000人以上の個人情報を保有することが要件に入っていましたが、現在はそれがなくなり、事実上「ほぼ全ての事業者」が該当します。

こちらの文章はA4用紙で3枚ほど。Open AIに出した文章よりは長いですが、前半は経緯などの「形式的なご挨拶」程度のものです。重要なのは、具体的な注意点が記された部分であり、対象を分けて記述されています。

一つ目は「個人情報取扱事業者」が対象です。

「生成AIサービスに個人情報を入力するときは、十分注意しましょう。」と言った内容です。今回、元の文章をわかりやすく書き換えていますので、その点ご了承ください。

個人情報を入力するのは何が何でもNGとは書いていません。利用目的さえ法令の範囲内であれば大丈夫ということでしょう。Open AI向けの文章にあった「要配慮個人情報」ではないことに留意してください。

さらに個人情報が「本人の同意なし」かつ「入力されたデータが目的外に使用された」場合は、個人情報保護法の規定に違反するかもしれませんよ。と注意されています。

ややふんわりした言い方になっています。個人情報が目的外に使用されるかどうかは事業者に把握できないかもしれないので、全ての責任を事業者に被せるのは無理があるからでしょうか。

二つ目は「行政機関等」を対象としています。

注意点は、個人情報取扱事業者に出した注意文と1ヶ所を除いて、全く一致しています。行政機関向けの注意には、「あらかじめ本人の同意を得ることなく」が入っていません。ということは、本人の同意なくとも行政機関であれば、個人情報を生成AIに入力しても問題はない、ということになりそうです。

民間(個人情報取扱事業者)と行政機関でほぼ同じ文章なのですが、1ヶ所だけわざわざ変えてあるため、余計なことまで考えてしまいますね。

最後の対象は「個人」です。私たち全員が対象となります。

「個人情報を入力したら、思わぬ形で利用されるかもしれません。」「文章生成AIが作成する文章は、自然な日本語であっても正しいとは限りません。」「だから、使う時には十分注意しましょう。」ぐらいの内容です。

ちょっと安心ですね。前二者のように「法律に違反するかもしれませんよ」というものではありません。*注3

Chat GPTを利用する上で注意すべきこと

どんなITサービスでも同じですが、その特徴や機能をよく理解した上でうまく活用することが重要です。個人情報に関わるデータは、できる限り入力しないように注意するのはもちろんです。

まず、Chat GPTは膨大なデータを元に、プロンプトに入力された質問に対する回答を自然な文章で返してくれます。しかし、どんなに自然な文章だったとしても、その内容が正しいとは限りません。

必ず、ソースを確認し自分の目で情報が正しいかを判断しなければなりません。

また勘違いしがちですが、Chat GPTにはオリジナルのアイディアや発想を生み出す能力はありません。あくまでたくさんのデータから、それらしい文章を「切り貼り」して作っているだけです。そのためオリジナリティを期待してはいけません。

「なんらかの新しい企画を検討したい」そんな時に一般的な事例としての叩き台を作るぐらいなら良いでしょう。しかし、Chat GPTが生成した企画をそのまま採用することはお勧めできません。おそらくどこかのアイディアを、結果的に真似していることになるでしょう。

文章の要約・会議の議事録作成・翻訳・検索した情報を簡潔にまとめる、さらに文章の校正などはChat GPTの活用が期待できる場面です。もちろん、ソースを確認して正確さが保証できれば、かなり作業時間の短縮に役立ちます。

「オリジナリティは期待できない」と記述しましたが、キーワードを与えて小説を書かせる、なんてことも実はできます。

Chat GPTで作成した小説を個人名で発表してはダメですが、「Chat GPTが生成した小説」と明記した上であれば面白いかもしれません。今後はこのような「創作分野での擬似的なオリジナリティ」というカテゴリーも登場するかもしれません。

【まとめ】

「生成AIサービスの利用に関する注意喚起等」の中には、生成AIサービスの活用が、気候変動問題等の国際社会の課題の解決に役立つという記述があります。しかし、この部分については多少疑問が残ります。

Chat GPTは独自の発想やオリジナリティのある着想はできません。「世界の誰かが作ったデータ」を組み合わせた文章を作るのが限界です。

しかも、米スタンフォード大の発表によると、AI開発には膨大な電力が使われ、地球温暖化に悪影響を与える可能性があるとのことです。

「イノベーションの促進、生産性の向上、教育効果の向上に役立つ」まではよかったのですが、気候変動はちょっと筆が滑ってしまったかもしれません。この問題はAIではなく、ちゃんと人間が考えるべき内容では無いでしょうか。*注4

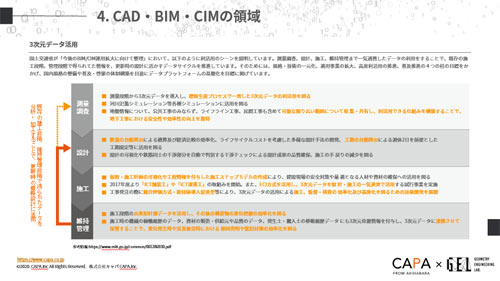

建設・土木業界向け 5分でわかるCAD・BIM・CIMの ホワイトペーパー配布中!

CAD・BIM・CIMの

❶データ活用方法

❷主要ソフトウェア

❸カスタマイズ

❹プログラミング

についてまとめたホワイトペーパーを配布中

■参考文献

注1 人事院 「個人情報保護委員会とは」

https://www.jinji.go.jp/jinji_kanto/saiyou/guide/guide_2023/10kojinjohohogoiinkai.pdf

注2

個人情報保護委員会 「生成AIサービスの利用に関する注意喚起等について」

https://www.ppc.go.jp/news/careful_information/230602_AI_utilize_alert/

「OpenAI に対する注意喚起の概要」

https://www.ppc.go.jp/files/pdf/230602_alert_AI_utilize.pdf

注3

「生成 AI サービスの利用に関する注意喚起等」

https://www.ppc.go.jp/files/pdf/230602_alert_generative_AI_service.pdf